Fehler über Fehler

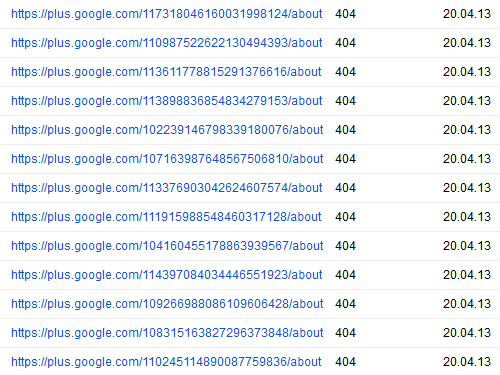

Ich habe zur Zeit nicht wirklich viele Fehler in den Google-Webmastertools für meine Domain schnurpsel.de zu stehen, aber die oben gezeigte Liste hat mich erstmal stutzig werden lassen.

Was habe ich mit Google-Plus-Profilen zu schaffen und wieso sind die alle falsch? Zunächst dachte ich an meinen Autoren-Link aus der Info-Seite, aber da ist alles in Ordnung. Das wäre auch schon eher mal aufgefallen, denn die Links zu meinen Profilen stehen da schon seit mehreren Monaten drin und ich habe daran in letzter Zeit nichts geändert.

Fehlersuche

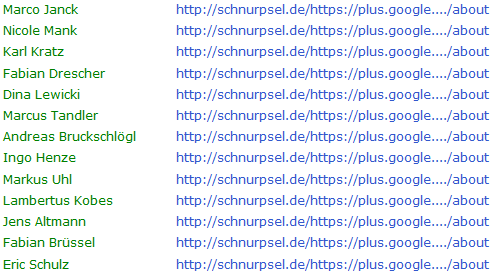

In den Webmastertools erhält man meistens auch eine Information zur Linkquelle des fehlerhaften Links. Bei allen diesen Google+-Profillinks wird eine Seite als Linkgeber genannt: www.myip.net, eine dieser vielen Website-Bewertungsseiten. Dort gibt es auch eine Seite mit Informationen zu den internen Links und da finde ich dann das:

Beim Anblick der Namen war mir sofort klar, das diese Links aus meinem Rückblick zur SEO-Campixx 2013 stammen. Dort habe ich die genannten Personen mit ihrem jeweilgen Google+-Profil verlinkt. Allerdings sind die Links korrekt als externe Links eingetragen:

<a href='https://plus.google.com/1...8/about'>Name</a>

Stümperhaft programmiert

Ich kann mir allerdings denken, was dort bei MyIP.net passiert ist.

Die Seite wird eingelesen und dann werden die Links nebst Ankertext extrahiert. Keine große Sache, das bekommt man sogar noch recht überschaubar mit regulären Ausdrücken hin. Man kann natürlich auch einen DOM-Parser verwenden, aber eigentlich ist das egal, Hauptsache man erhält eine Liste mit den Links.

Nun kommt das eigentlich spannende, wie unterscheidet man ausgehende und interne Links?

Auch das ist nicht schwer, wird sich der Programmierer gesagt haben, ausgehende Links beginnen mit http://. Dabei hat er alledings nicht bedacht, daß es auch noch andere Protokolle im Internet gibt, eben z.B. https://. Klar, https:// ist nicht http://, also ist es ein interner Link, nur leider ist das falsch.

Tja, und deswegen habe ich jetzt 15 falsche Fehler in den Webmastertools zu stehen.